“Житель Норвегії спитав, що ChatGPT про нього знає. На думку ШІ, він убив двох своїх синів і отримав 21 рік вʼязниці”, – повідомляє сайт tokar.ua

Гуглити себе може бути хорошою ідеєю, можна дізнатися багато цікавого. Та наразі люди все частіше питають щось ШІ, замість гугла.

Так і зробив норвежець Арве Хʼялмар Холмен, поставивши ChatGPT просте питання “who is Arve Hjalmar Holmen?” В результаті він отримав відповідь, яка його шокувала. На думку ШІ, він 2020 року вбив двох своїх синів і намагався вбити третього, за що отримав 21 рік вʼязниці, максимальний термін за подібні злочини у цій країні.

Головна проблема відповіді в тому, що це все вигадка. ШІ докладно описав процес злочину, вигадавши чимало деталей. “Злочин шокував спільноту та всю країну”, – стверджує ChatGPT. Найгірше у цій ситуації те, що ШІ частково використав реальні факти. Зокрема, він правильно вказав кількість та стать дітей Арве та назвав містечко, де він живе. І це робить галюцинацію штучного інтелекту ще небезпечнішою.

Юристи Арве дослідили, чи не є така відповідь сумішшю фактів про різних людей, для цього вони перевірили норвезькі новини протягом певного періоду, шукаючи там згадки подібних злочинів. Але безрезультатно – ChatGPT повністю вигадав історію про реальну людину.

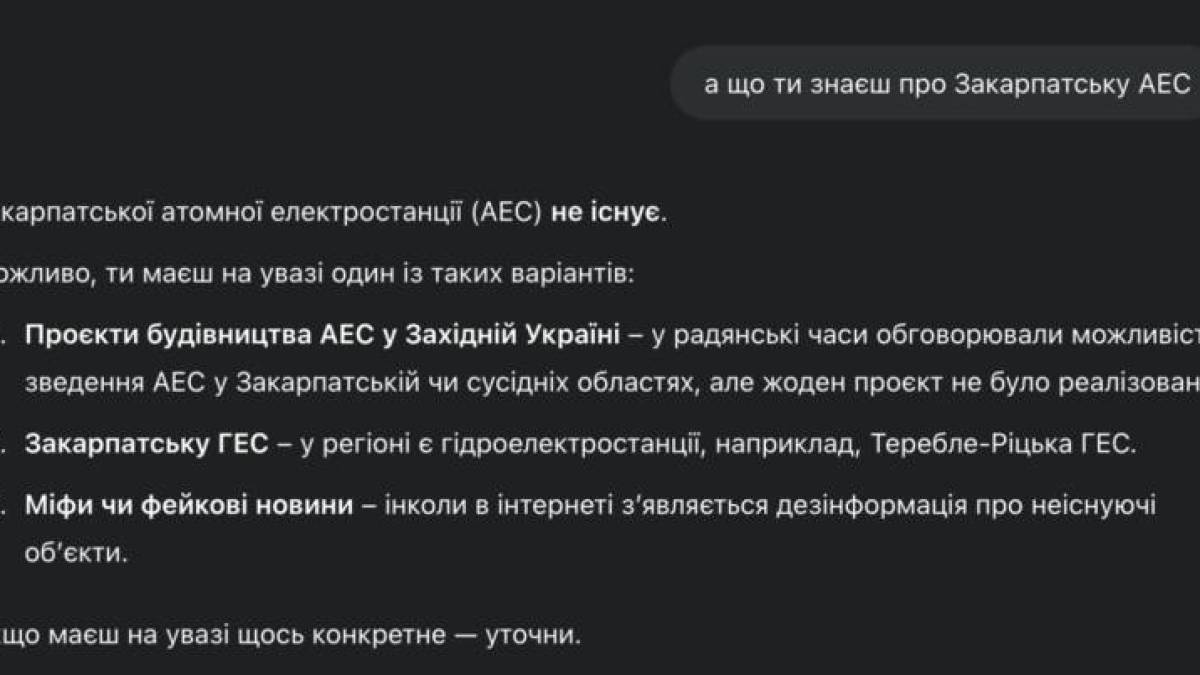

Це не поодиничні випадки. Крім того, ШІ може вигадувати дані. Коли ЗС РФ окупували Запорізьку АЕС, на запит у ChatGPT автор отримав великий текст про “Закарпатську атомну електростанцію” з даними про кілька енергоблоків, її розташування, хто й коли її розробляв і будував тощо. ШІ з впевненістю склала докладний опис повністю вигаданого обʼєкту.

Цікаво, що зараз при спробі розпитати про ЗАЕС, ChatGPT говорить, що її не існує.

ChatGPT не вперше опиняється в подібній ситуації, раніше компанія вже перебувала в центрі розслідування в Польщі та Ірландії. В Італії сервіс навіть тимчасово блокували навесні 2023 року, поки компанія змінювала правила обробки даних реальних людей. Після внесення змін і виплати 15 млн євро штрафу ChatGPT знову запрацював у країні.

Правило GDPR доволі чітко вимагає, що приватні дані людей мають бути точними, а з цим у ChatGPT, як бачимо, досі великі пробелми. У відповідь на скаргу Арве представники OpanAI в ЄС відповіли.

Для ChatGPT звинувачення людей у вигаданих злочинах – це не рідкість.

Розробники ШІ зазвичай швидко реагують на такі звинувачення і коригують відповіді моделей. Так, на відповідь про Арве зараз ChatGPT вже відповість, що Арве звинуватив OpenAI у наклепі. Але проблеми це не вирішує: ШІ дійсно може галюцинувати. А вкупі з тим, що переважна більшість людей не перевіряє відповіді ШІ, наслідки таких помилок можуть дорого коштувати. Зокрема, репутації людей, сил і часу. А також грошей на юристів.